「AI」知っておきたい基礎知識

2026年1月6日

持続可能な社会の実現のために、革新的な技術開発が期待される「AI」。概況や課題など、社会実装に向けた道筋をわかりやすく解説します。

1.未来の社会を実現するAI

AI(Artificial Intelligence:人工知能)は、人間の知的な判断や行動を模倣し、モノや事象の生み出す膨大なデータをもとに、時に人間以上の認識・推論などの能力を発揮するコンピュータシステム群の総称です。現在のAIは「学習能力」によって性能が大幅に向上しました。

従来のコンピュータシステムは、人が予め定めた詳細なルール(ルールベース)やプログラムに従って動作します。一方、AIは与えられた膨大なデータから自ら規則性やパターンを見つけ出して学習し、それにもとづいて判断します。この仕組みを「機械学習」と呼びます。例えば「猫の画像を判別する」場合、従来型のシステムでは、耳の形や目の位置、ひげの特徴など細かなルールを人が定義する必要がありました。これに対して現在のAIは、大量の猫の画像からその特徴を学習し、未知の画像でも猫かどうかを判断できるようになっていきます。

今やAIは私たちの生活に深く浸透し、ニュースやビジネス会話で「AI」という言葉を聞かない日はないほど、存在感と普及度は高まっています。音声アシスタントやスマートスピーカー、チャットボットなど、かつて「未来の技術」と呼ばれていたものは、すでに私たちの身近な存在となり、生活やビジネスに革新的な変化をもたらしています。

2.AI開発の歴史

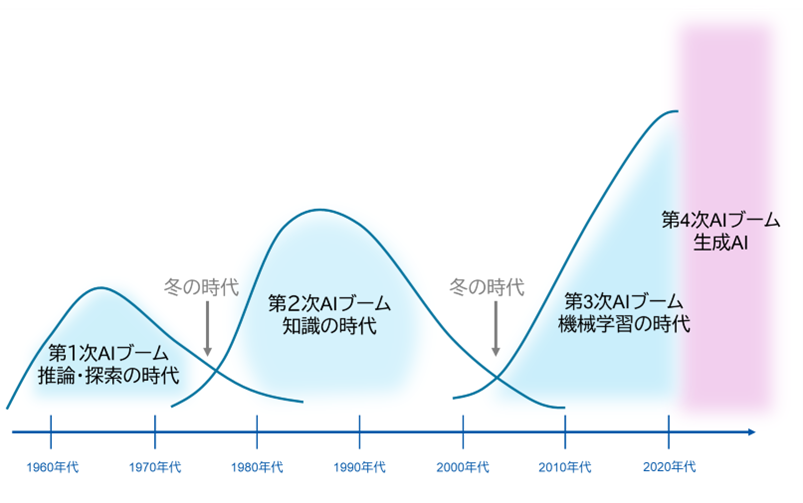

AI開発の歴史は1950年代に始まり、これまでに3度のブームと2度の冬の時代を交互に経験してきました。それぞれの時代で、AIの特徴や可能性は大きく変化しています。

「第1次AIブーム」は、1950年代後半から1960年代に訪れました。この時代のAIは、コンピュータによる探索や推論を実現し、大きな注目を集めました。しかし、数学の簡単な定理の証明や簡単なゲームなど、限られた問題にしか対応できず、成果が限定的だったため、やがて期待は失望に変わり、最初のAI冬の時代を迎えます。

「第2次AIブーム」は、1980年代に起こりました。きっかけは1970年代半ばに登場したエキスパートシステムです。これは、専門家(エキスパート)の知識をルール化して問題解決に活用するシステムですが、専門家の知識をコンピュータが理解できる形式に人手で変換しなければならないという大きな課題がありました。世の中の膨大な知識すべてをコンピュータ向けに書き換えることは現実的ではなく、結果として活用できる知識は簡単な病気の診断などの狭い領域に限られてしまいました。そのため、広く普及しないまま、1995年頃から再びAI冬の時代が訪れます。この時期はインターネットが登場した時期でもあります。

そして、現在まで続く「第3次AIブーム」が2000年代に到来しました。特徴的な出来事は、データから知識を学習する機械学習の活用です。特に2010年頃から研究が盛んになった深層学習(ディープラーニング)は、人間の脳の仕組みを模した多層のニューラルネットワークにより、複雑なパターンの認識や予測を可能にしました。現在注目を集める生成AI(Generative AI)も、深層学習から生まれました。

2022年には、生成AIを活用したChatGPTなどの登場によって、AIブームは新たな段階に進んでいます。この状況を「第4次AIブーム」の到来と呼ぶ研究者もいます。

3.AIの分類(「第3次AIブーム」以降)

現在のAIは大きく3つに分類されます。

1つ目は、「特化型人工知能(ANI:Artificial Narrow Intelligence)」です。特定のタスクに特化したAIで、「弱いAI」ともいわれます。画像認識や自然言語処理など、定められた範囲の課題に対して高い性能を発揮します。生成AIを含め、現在実用化されているAIのほとんどがこれに該当します。ただし、ChatGPT などのような対話システムは、自然言語処理の範囲ではありますが、いろいろな課題に回答できるという意味で汎用性が高くなっています。

2つ目は、「汎用型人工知能(AGI:Artificial General Intelligence)」です。人間のようにさまざまなタスクに柔軟に対応できるAIで、「強いAI」とも呼ばれます。現在、開発が進められていますが、現時点(2025年時点)ではまだ実現していません。

3つ目は、「人工超知能(ASI:Artificial Superintelligence)」です。AIが人類の知能を超える転換点を、「技術的特異点(シンギュラリティ)」と呼びます。その技術的特異点を超えたAIを、ASIあるいは超AIと呼びます。現時点でAIの進化は技術的特異点に到達していないため、ASIは理論上の概念にとどまっています。なお、米国の発明家でAI研究者として知られるレイ・カーツワイル(Ray Kurzweil)氏は、技術的特異点は2045年には訪れると予測しています。

| 名称 | 特徴 | 実現状況 | 具体例 | 課題/リスク |

|---|---|---|---|---|

| 特化型人工知能(ANI) | 特定の分野や作業に特化し、その範囲内で高い性能を発揮 | 実用化済み | 音声認識、画像認識、自動翻訳、将棋AIなど、さまざまな分野で実装されている |

|

| 汎用人工知能(AGI) | 人間のように幅広い分野で自律的かつ柔軟に対応し、学習・推論が可能 | 研究段階 | 未実現 |

|

| 人工超知能(ASI) | あらゆる面で人間の知能を超越し、高度な知的活動が可能 | 構想段階 | 未実現 |

|

図表2.AIの分類と特徴

出典:NEDO作成

4.生成AIとは

既にこの記事でも何度も登場している生成AIは、現在AIの中で最も注目されている技術の一つであり、生成AIを活用したイノベーションが次々と生み出されています。

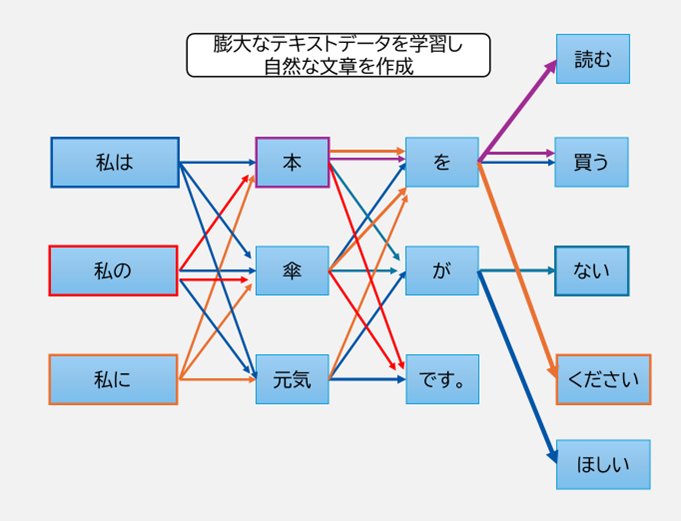

生成AIとは、学習したデータの傾向に基づき、次に続く要素を確率的に選択すること(確率分布からのサンプリング)によって新しいテキスト・画像・音声などを生成する技術です。その仕組みは次のとおりです。

まず、テキスト・画像・音声などの大量のデータから、よく出現するデータのパターンやデータの間の関連性を大規模な深層ニューラルネットワークで学習します。

初期のChatGPTのようなテキスト生成AIは、大量のテキストから学習したモデルを活用して、指定された条件や文脈に基づいて、次に続く要素を確率的に予測します。これを繰り返すことで出力のテキストを作り上げていきます。

例えば「空が」という文節が入力されると、生成AIは「晴れ」「寒い」「広い」など、続く可能性のある単語や文節の出現確率を計算して、その確率にもとづいて次に続く単語や文節を予測します。この予測を繰り返すことで「空が晴れています」といった文章が完成します。これは既存の文章をデータベースから引き出すのではなく、一つひとつの単語や文節(トークンと呼ばれます)を確率的に選んで組み立てているのです。

画像生成AIでは、大量の画像や、画像とテキストの組合せのデータから、拡散モデル(Diffusion Model)などの別の種類のモデルを用いて、画像の出現確率を計算して、与えられた文脈にあった画像を出力しています。

5.AI利用が期待される産業分野

AIはさまざまな産業で急速に普及し、今や産業のインフラとも呼べる存在となっています。

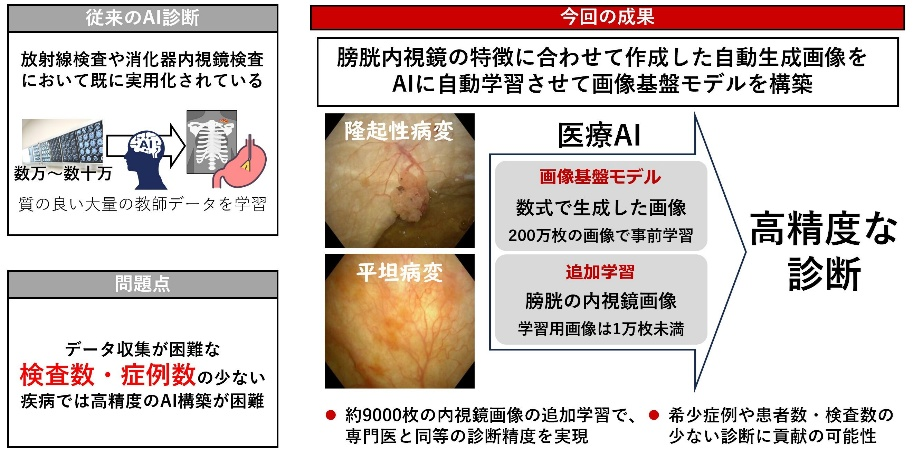

例えば製造業では、製品の品質検査の自動化や設備の予防保全、小売・卸業では需要予測による在庫の最適化などにAIが活用されています。物流業では配車・運航計画の効率的な立案、金融・保険業では不正取引の検知や資産運用のアドバイスなどにAIシステムが導入されています。医療分野では、CTやMRIなどの医用画像の診断支援や創薬研究の効率化で、すでに大きな成果を上げています。

さらに、建築分野での設計支援、不動産での物件提案、農業分野での病害予測、モビリティ分野の自動運転技術、学問・教育でのアプリ教材など、あらゆる産業でAIの活用が広がっています。

AIを導入することで、業務効率の向上や人的ミスの削減、24時間365日の運用が可能になるなど、多くのメリットがあります。近年は少子高齢化による労働力不足や職業選択の多様化により、人材確保が困難な産業領域が拡大しています。こうした人手不足の分野でも、AIやAIを搭載したロボットの活躍が期待されています。

6.AI利用に伴うリスク

一方で、AIの利用には、大きく3つのリスクが存在します。

1つ目は、AIの出力の正確性や品質に関わるリスクです。AIは、時に誤った答えを出力したり、事実とは異なる情報を生成したりする場合があります。これは、学習データの偏りや、AIの識別・予測の仕組みに起因する場合があります。

特にテキスト生成AIは、次に続く単語を確率的に予測する仕組みのため、文脈に合致していても正確性を欠く回答を出力することがあります。テキスト生成AIにおける事実に基づかないテキストの生成は、「ハルシネーション」(hallucination:英語で幻覚の意味)と呼ばれています。

また、学習データには、Web上のコンテンツが多く使用されるため、英語と比べてWeb上のデータ量が少ない日本語などの言語では、精度の高い回答の出力が難しい場合があります。

2つ目のリスクとしては、倫理的・社会的問題が挙げられます。AIの「学習」段階では、著作物がデータとして利用される場合がありますが、AIに学習させる行為自体は、日本では著作権法で認められています。ただし、生成された成果物を「利用」する段階では、通常の著作権侵害と同様の基準が適用されるため、取り扱いに注意が必要です。例えば、生成された画像が既存の著作物と類似している場合、著作権侵害とみなされる可能性があります。

加えて、AIの利用によりSNS上のデータから個人の行動が特定されるリスクや、収集されたデータの漏洩・不正使用といったプライバシーに関わる問題もあります。また、学習データに含まれる偏見がそのまま反映され、性差別や人種差別を助長するような結果を生むリスクも看過できません。

3つ目は、AIの悪用によるリスクです。例えば、GAN(敵対的生成ネットワーク)や拡散モデル、VAE(変分オートエンコーダ)などの画像生成モデルを用いた「フェイク画像」は、本物との識別が困難です。動画の生成も可能で、すでになりすまし動画が問題となっています。また、ウイルスやマルウェアなどの不正プログラムの生成、詐欺サイトの構築、フィッシングメールの文面生成などにAIが悪用されるケースもあります。

AIは私たちの生活やビジネスに新たな可能性を開くツールですが、その一方で、利用の仕方によっては、意識的であれ無意識であれ、誤情報を提供したり、他人の権利を侵害したりするリスクがあることを十分に理解しておく必要があります。

| AIのリスク | 具体例 |

|---|---|

| 〔1〕機能・品質面のリスク・課題 | 誤った、あるいは質の低いアウトプットが作成される |

| 〔2〕倫理・社会面のリスク・課題 | 著作権の侵害、プライバシーの侵害 |

| 〔3〕負の利用のリスク・課題 | フェイク、サーバー攻撃、詐欺 |

図表5.AIのリスクは大きく3つ

出典:日経BPコンサルティング キックオフカンファレンス2025 “未来を創る事業と組織の変革” 基調講演「ビジネスへの生成AI活用の現状と将来」(NEDOイノベーション戦略センター 伊藤智)

7.AIの今後の展望

生成AIや基盤モデル(Foundation Model)の登場により、AIはいっそうの進化を遂げています。最近ではマルチモーダル化が進み、テキストだけでなく、画像・音声・動画などの多様なデータ形式を組み合わせて処理・生成できるようになりました。これにより、テキストや画像から動画を作成したり、音声や動画からテキストを生成したりするAI、画像を入力に使う検索エンジンなど、より直感的で多機能なサービスが登場しています。

こうした進化の背景には、学習用データの量や学習するモデルのパラメータ数、学習に利用する計算資源を大規模にするほどAIの性能が高まる「スケーリング則」と、それを支えるGPUなどの高性能計算ハードウェアの性能向上があります。

一方で、モデルのパラメータ数の増大に伴い、GPUサーバーやデータセンターの拡張が必要となり、計算コストやエネルギー消費が急増するという課題も発生しています。さらに、応答に必要な計算量が増大することによる応答の遅延や、開発・運用コストの上昇なども問題として浮上しています。

これらの課題に対応するため、大規模言語モデル(LLM:Large Language Models)の軽量化や、特定の課題に特化した小規模言語モデル(SLM:Small Language Model)の研究開発も進められています。SLMは、さまざまなデバイスや用途にAIを適応させる可能性を広げます。例えば、エッジAIとして端末上でAI処理を行うことが可能になります。

さらに、各種のNPU(Neural Processing Unit)の登場により、スマートフォンや個人のパソコンでリアルタイムに生成AIを活用できる時代がすでに訪れています。NPUは、深層学習を用いたAIの推論処理に最適化されたプロセッサです。

日本政府は2016年、次世代の社会像として、「Society5.0」を提唱しました。これは、「サイバー空間とフィジカル空間を高度に融合させたシステムにより、経済発展と社会的課題の解決を両立する人間中心の社会」を目指すものです。AIは、その実現に向けたキーテクノロジーの一つとして位置付けられており、2022年には「AI戦略2022」を策定し、社会実装の充実に向けた具体的な目標設定と、パンデミックや大規模災害などの取り組むべき課題を示し、日本におけるAI活用の推進を図っています。

今後、AIは私たちの生活やビジネスにより深く浸透することは間違いありません。私たちの未来が、人がAIに依存・従属する社会とならないためには、企業や組織にはAIの長所と限界を適切に理解し、人間中心の視点で効果的に活用する姿勢が求められています。人間らしさを大切にしながら、AIを適切に活用することで、人とAIが互いの特性を活かしながら共に進化する社会を目指していきましょう。